Keynotes & Programm

Die Veranstaltung fand am 14. März 2023 in Berlin, Deutschland, statt.

Keynote-Speaker

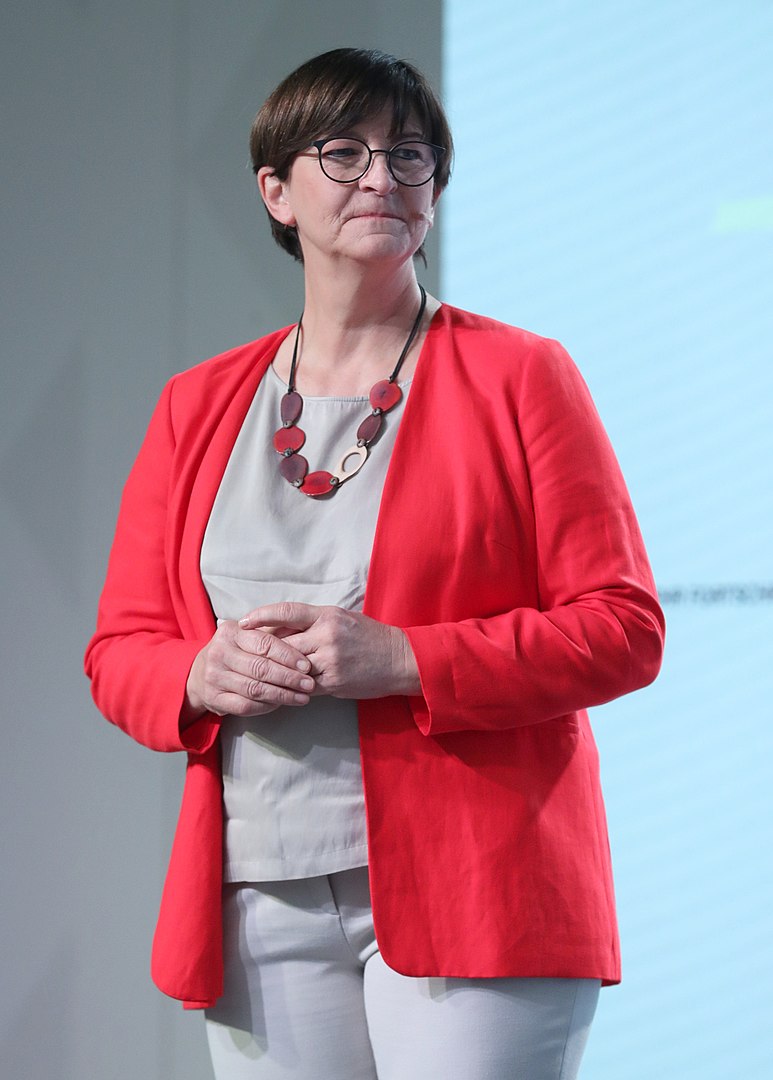

Von Sandro Halank, Wikimedia Commons, CC BY-SA 4.0, CC BY-SA 4.0, wikimedia.org

Von Sandro Halank, Wikimedia Commons, CC BY-SA 4.0, CC BY-SA 4.0, wikimedia.org

|

Saskia Esken ist Bundestagsabgeordnete der SPD und seit Jahren als Digitalpolitikerin bekannt: Sie setzte sich gegen Uploadfilter und Vorratsdatenspeicherung ein und für ein Recht auf Verschlüsselung. Sie war 2013-2019 Mitglied und stellvertretende Sprecherin der Fraktionsgruppe Digitale Agenda und von 2018-2019 Mitglied der Enquetekommission “Künstliche Intelligenz”, bis sie im Dezember 2019 zur SPD-Bundesvorsitzenden gewählt wurde. Neben den digitalen Themen setzt sie sich vor allen Dingen für Bildungs- und Chancengerechtigkeit ein.

|

Von Web Summit - PO2_5268, CC BY 2.0, wikimedia.org

Von Web Summit - PO2_5268, CC BY 2.0, wikimedia.org

|

Gary Marcus ist Entrepreneur, Bestseller-Autor und war Professor für Psychologie und Neurowissenschaften an der New York University. Er gab diesen Job aber für sein Start-Up “Geometric Intelligence” auf, das mit Hilfe neuester KI-Techniken Problemlösungen sucht für Situationen, in denen es nur wenige Trainingsdaten gibt. Geometric Intelligence wurde 2016 von Uber gekauft. Sein aktuelles Buch heißt “Rebooting AI - Building Artificial Intelligence we can trust” (zusammen mit Ernest Davis, 2019).

|

Programm

Dienstag, 14. März, 2023

| 09:00 | Begrüßung (Zweig) |

| 09:05 | Begrüßung (Landesvertretung Rheinland-Pfalz) |

| 09:10 |

Wann KI keinen Platz vor Gericht hat (Zweig) In den letzten Jahren haben wir uns mit der Sprechakttheorie von Austin beschäftigt und mit der Frage, wann ein Sprechakt gelingt, wenn ADM-Systeme im Spiel sind. In meinem Vortrag werde ich zeigen, dass hoheitliche Sprechakte, inbesondere Bewertungen von menschlichem Verhalten oder Rechtsprechung, weil sie einer Begründung bedürfen, durch KI nicht unterstützt werden können, weil eine solche von der Maschine nicht geliefert werden kann. |

| 09:30 | Keynote (Saskia Esken) |

| 09:45 |

Learning from Uncle Sam? Was uns die Einführung von ADM-Systemen in den US-Staaten lehrt (Wenzelburger) Viele Einzelstaaten der USA haben in den letzten Jahren ADM-Systeme in der Strafjustiz landesweit eingeführt. Unter der Überschrift von „smart on crime“ wurde diese Entwicklung teilweise von beiden großen amerikanischen Parteien wie auch, zumindest anfangs, von Organisationen der Zivilgesellschaft unterstützt. In meinem Vortrag stelle ich Ergebnisse aus unserer Forschung zu den politischen Entscheidungen für den Einsatz von ADM-Systemen in US-Staaten im Bereich der Untersuchungshaft vor und zeige, dass der Siegeszug der ADM-Systeme einerseits auf den speziellen Kontext der USA mit hohen Gefangenenraten gerade auch in der Untersuchungshaft und der damit zusammenhängenden hohen Ausgaben für die Strafjustiz, und andererseits auf eine starke Tradition der datenbasierten Entscheidungen im Bereich der Strafjustiz allgemein zurückzuführen ist. Gleichzeitig zeigt der Vortrag auf, welche Schwierigkeiten sich bei der Implementierung ergeben und versucht, Lehren aus den Erfahrungen der USA zu ziehen. |

| 10:10 |

Constitutional principles as safeguards against the algorithmic injustice and the abuse of decision-making power by public authorities (Yeung) Our investigations have focused on algorithmic decision-making tools employed to inform ‘rights critical’ decisions by public authorities, including decisions about the coercive detention of individuals. In this talk, I demonstrate that public law principles, and more specific legal duties grounded in those principles, are routinely overlooked in the building and implementation of algorithmic tools to inform decisions by public authorities. In this way, seemingly ‘technical’ choices made by developers create serious constitutional dangers, enhancing the likelihood and scale of injustice and the abuse of decision-making power. I argue that unless algorithmic decision-support tools used to inform rights-critical decisions by public authorities are configured and implemented in a manner that is demonstrably compliant with public law principles and doctrine, including respect for human rights, they should not be used. |

| 10:35 | Pause |

| 11:00 |

Architektonische Perspektiven auf algorithmisches Entscheiden im Recht (Schulz) In der Informatik sind der Architektur entlehnte Perspektiven und Denkmuster weit verbreitet. Die Rechtswissenschaft kennt ebenso architektonische Allegorien und strukturbezogene Begriffe. Unsere Forschungen haben gezeigt, dass eine architektonische Perspektive besonders hilfreich für die soziotechnische Analyse algorithmischer Entscheidungssysteme ist, wenn diese in staatlich-rechtliche Entscheidungszusammenhänge implementiert werden. Dieser neuartige entscheidungsarchitektonische Ansatz wird vorgestellt, der eine neue Perspektive auf Entscheidungen gestattet, die strukturellen Veränderungen bei der Einbeziehung algorithmischer Systeme sichtbar macht und sich weiterhin als Rahmenwerk für interdisziplinäre Forschungsansätze in technisch-rechtlichen Kontexten anbietet. |

| 11:25 |

Wie reagieren Richter*innen auf KI (Achtziger) Wir haben empirische Studien mit Rechtsexperten durchgeführt, um zu erforschen, wie Juristen im Vergleich zu Laien auf Empfehlungen im Bezug auf ihre Rechtsprechung reagieren. In unserem Vortrag werden wir die Ergebnisse dieser Studien präsentieren und aufzeigen wie Laien, Rechtsreferendar*innen und erfahrene Richter*innen auf die Empfehlung einer KI im Vergleich zur Empfehlung einer Supervisionsgruppe reagieren. Wir haben den Einfluss der Empfehlungen auf das Urteil, sowie die Zuversicht in die eigene Entscheidung und eine Risikobewertung untersucht. |

| 12:00 | Keynote: Rebooting AI - Building Artificial Intelligence we can Trust (Gary Marcus) |

| 12:50 | Mittagessen |

Organisation

Prof. Dr. Katharina A. Zweig, RPTU Kaiserslautern

Prof. Dr. Wolfgang Schulz, Leibniz-Institut für Medienforschung │ Hans-Bredow-Institut (HBI)

Prof. Dr. Georg Wenzelburger, Universität des Saarlandes

Prof. Dr. Anja Achtziger, Zeppelin Universität Friedrichshafen

Prof. Dr. Karen Yeung, University of Birmingham

Veranstaltungssponsoren und Kooperationspartner